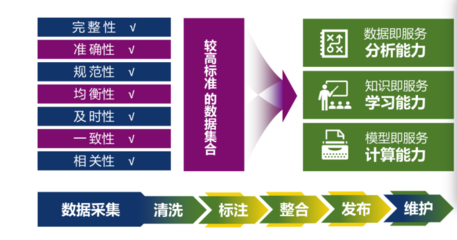

在微服务架构的演进过程中,数据治理已成为确保系统稳定性、可观测性与业务连续性的核心挑战之一。随着服务数量的增长,数据分散、异构、一致性问题日益凸显。本节将深入探讨微服务数据治理的关键方案,并重点聚焦于数据处理服务的构建与实践。

一、微服务数据治理的核心挑战

- 数据孤岛与一致性:每个微服务拥有独立的数据库,导致业务数据分散,跨服务事务与数据一致性难以保障。

- 数据异构与标准化:不同服务可能采用不同的数据格式、存储引擎或协议,增加了集成与处理的复杂度。

- 数据质量与可靠性:数据在流转中可能因网络延迟、服务故障等出现丢失、重复或错误。

- 实时处理与历史回溯需求:业务既需要低延迟的实时数据处理,又需支持历史数据的查询与分析。

二、数据处理服务的设计原则

为应对上述挑战,数据处理服务应遵循以下设计原则:

- 松耦合与高内聚:数据处理逻辑应独立于业务服务,通过事件驱动或API接口进行交互。

- 可扩展与容错性:支持水平扩展,通过重试机制、死信队列等确保数据不丢失。

- 标准化与兼容性:定义统一的数据格式(如Avro、Protobuf)和通信协议(如gRPC、Kafka),降低集成成本。

- 可观测与可审计:集成日志追踪、监控指标,实现数据处理全链路的可视化与故障排查。

三、关键架构模式与实践

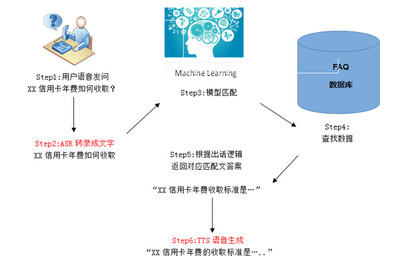

- 事件驱动架构(EDA):

- 通过消息中间件(如Apache Kafka、RocketMQ)实现服务间异步通信,将数据变更作为事件发布,由数据处理服务订阅并处理。

- 优点:解耦服务依赖,支持最终一致性,提升系统吞吐量。

- CQRS(命令查询职责分离)模式:

- 将数据写入(命令)与读取(查询)分离,针对高频查询场景可构建独立的读模型(如Elasticsearch、ClickHouse),减轻主数据库压力。

- 数据处理服务负责同步写模型到读模型,确保数据实时性。

- 数据管道与流处理:

- 采用流处理框架(如Apache Flink、Spark Streaming)构建实时数据管道,支持数据的清洗、转换、聚合与入库。

- 示例场景:用户行为日志实时分析、库存变动实时监控。

- 数据版本与血缘追踪:

- 为数据实体添加版本号或时间戳,结合元数据管理工具(如Apache Atlas)记录数据来源、处理步骤与流向,便于溯源与合规审计。

四、实施案例:订单数据处理服务

假设电商平台中,订单服务与库存服务独立部署,需确保下单时库存数据的一致性:

- 事件发布:订单服务创建订单后,发布“订单已创建”事件至Kafka。

- 事件处理:数据处理服务消费该事件,调用库存服务API进行库存扣减,并记录处理结果。

- 异常处理:若库存不足,数据处理服务发布“库存扣减失败”事件,触发订单状态回滚与用户通知。

- 数据同步:将订单与库存变动记录同步至读模型(如Elasticsearch),支持实时订单查询。

五、工具与技术栈推荐

- 消息中间件:Kafka(高吞吐)、RocketMQ(事务消息)。

- 流处理框架:Flink(低延迟复杂计算)、Kafka Streams(轻量级集成)。

- 数据存储:MySQL(事务型)、MongoDB(文档型)、Redis(缓存)、时序数据库(如InfluxDB)。

- 监控与追踪:Prometheus(指标收集)、Jaeger(分布式追踪)、ELK(日志分析)。

六、

微服务数据治理的核心在于平衡数据自治与全局一致性。通过构建专业的数据处理服务,采用事件驱动、CQRS等模式,结合流处理与可观测工具,能够有效化解数据分散带来的挑战,为业务提供高效、可靠的数据支撑。在实践中,需根据业务场景灵活选择架构与技术,并持续迭代优化数据处理链路,以应对未来数据规模与复杂度的增长。